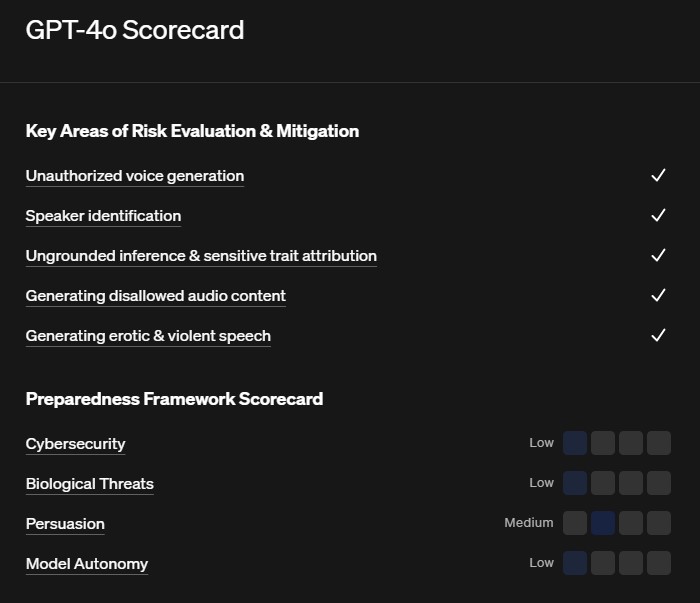

Openaiהוא הפך את "כרטיס מערכת GPT-4O", מסמך מחקר שממחיש את אמצעי הבטיחות ואת הערכות הסיכונים שנערכו לפני השקת מודל הבינה המלאכותית האחרונה שלה. ועל פי הערכת Openai,ל- GPT-4O יש "סיכון בינוני"ו סיווג זה נובע מההערכה הגבוהה ביותר בין ארבע קטגוריות סיכון: אבטחת מחשב, איומים ביולוגיים, שכנוע ואוטונומיה של המודל.

כל הקטגוריות נחשבו לסיכון נמוך, למעט שכנוע, כאשר כמה דגימות כתיבה של GPT-4O הוכיחו כיעילות יותר בשכנוע הקוראים בהשוואה לטקסטים שנכתבו על ידי בני אדם.

פרסום הערכת סיכונים זו מתרחש ברגע מכריע עבור Openai. החברה הייתה נושא לביקורות מתמשכות לגבי תקני הבטיחות שלה, הן על ידי עובדיה והן על ידי הסנאטורים בארה"ב. השקת מודל רב -מודאלי כה רב עוצמה בסמוך לבחירות לנשיאות ארה"ב, למעשה, מעלה חששות מהסיכון הפוטנציאלי להתפשטות מקרית של דיסאינפורמציה או שימוש זדוני על ידי שחקנים מותקפים. Openi מקווה להפגין את מחויבותו למנוע התעללות באמצעות פרסום מבחנים אלה.

בקשות רבות הועלו כך שפתאתי שקופה יותר, לא רק על נתוני האימונים של הדגמים שלה, אלא גם בבדיקות הבטיחות. בקליפורניה, שם מבוסס Openai, הסנטור סקוט וינר עובד על הצעת חוק כדי להסדיר מודלים לשוניים גדולים, ומציג מגבלות שיהפכו חברות לאחראיות כחוק למקרה של שימוש מזיק ב- IA שלהן.

בקיצור, פרסום כרטיס ה- GPT-4O הוא קטע שמטרתו להראות את המחויבות של Openai לשקיפות, אך גם מעלה שאלות לגבי יכולתה של החברה להעריך באופן אובייקטיבי את הסיכונים במודלים שלה. הלחץ ההולך וגובר לוויסות גדול יותר של ה- AI עלול להוביל לשינויים משמעותיים באופן שבו חברות כמו OpenII מפתחות ושחרור את המודלים שלהן.

מה אתה חושב? האם אתה זקוק לתשומת לב רבה יותר לאינטליגנציה המלאכותית שנקראה כל כך? ספר לנו את ההערות למטה.